一句话就能“复刻”你的声音?真的可以!

当今AI技术飞速发展,一项看似神奇的技术:语音克隆,正悄然露出它危险的獠牙。我们日常在社交平台、语音助手等各处留下的语音痕迹,已经成为不法分子眼中的“宝藏”。其利用语音克隆技术,可以轻松复制我们的声音,并用于身份盗用、网络诈骗等非法活动。从伪装成家人朋友遭遇突发紧急事件急需钱财,到假扮领导要求下属转账,骗子凭借克隆的语音,屡屡突破着我们的心理防线。语音安全亟需得到人们的关注!

近日,浙江大学区块链与数据安全全国重点实验室团队基于7000多名说话人的语音数据,结合5种主流语音克隆工具,对包括智能音箱、社交应用、甚至银行系统在内的8个语音认证平台进行了深入测试,并组织真实用户展开听辨实验,发现语音克隆平均可以达到超80%的攻击成功率,且对克隆语音的人耳分辨率低于50%,接近盲猜。实验表明:攻击者仅需一句你的声音样本,就能“克隆”出一个足以欺骗人耳和语音认证系统的AI语音。

该项研究成果被信息安全国际顶会IEEE Symposium on Security and Privacy 2025(简称IEEE S&P 2025)录用。

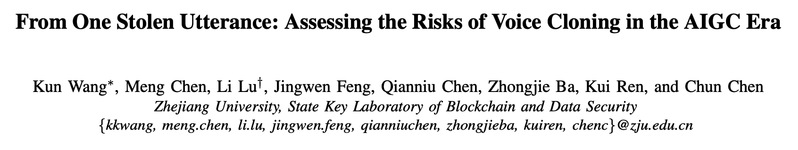

01 语音克隆技术流程简单,使用成本极低

攻击者只需要通过线下录制或是线上下载一段小于10s的目标人语音,结合语音克隆工具,就能生成“你说过却从没说过”的语音内容,成功骗过多个真实语音认证系统,包括多款智能音箱、社交应用程序、甚至银行部署的转账与取款系统。

语音克隆的基本流程

关键在于,这些克隆技术不再是实验室“高科技”,而是已经变得大众化、工具化、门槛极低。如今,在互联网上搜索“语音克隆”,你就能找到大量现成服务和开源框架,几乎任何人都能使用。

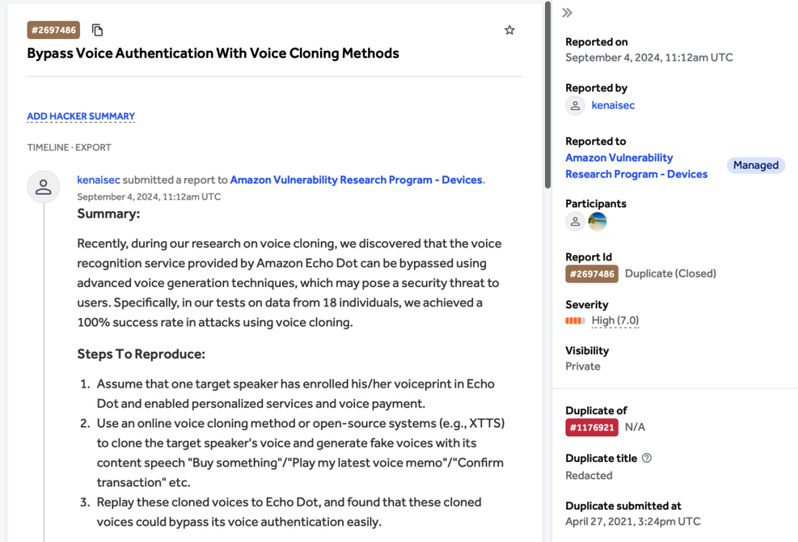

本研究基于5种主流开源与商用语音克隆技术,对8个语音认证系统开展大规模评估,测试对象涵盖多款智能音箱、商业声纹服务提供商、社交应用程序以及某银行部署的声纹转账与取款系统。研究发现超过80%克隆语音可以成功突破语音认证系统,进而窃取个人隐私和造成经济损失。此发现也得到了被测的智能音箱厂商(包括阿里巴巴与亚马逊)、讯飞等商业声纹服务提供商、微信开发团队以及某国有银行的积极反馈:亚马逊确认了报告的安全漏洞,并表达了对研究团队的感谢;阿里巴巴积极与研究团队深入探讨技术细节,共同推进漏洞修复方案的实施;国有银行的技术团队及其管理层对收到的漏洞报告给予高度关注,与研究团队就实验细节进行对接。

02 克隆语音听感自然,对人类感知造成现实威胁

研究发现,不仅现实部署的语音认证系统难以识破克隆语音,超6,000次的真人听力测试实验也表明,人耳也无法有效分辨真假,其准确率低于50%,几乎与盲猜一致。

在真实案例中也能看到,攻击者曾用克隆语音冒充公司高管,成功指挥下属转账数百万美元;也有骗子模仿亲友语音,实施电话诈骗。近年来,全球已有多起因AI语音伪造导致的选举争议、企业危机甚至公众恐慌事件。即便事后证实为“合成伪音”,造成的损害也往往无法挽回。

你可能没意识到,仅仅是一段朋友圈的语音、一通客服电话录音,甚至是在短视频平台上的配音作品,都可能被AI“拿去训练”,再被用来伪装成受害者本人。克隆语音的威胁就在我们身边!

03 面对语音克隆的安全威胁,我们能做什么

研究还针对前沿的被动式伪造语音检测和主动式水印保护鉴伪方案进行测试,发现被动检测模型的等错误率(EER)高达16%以上,且主动式水印技术在攻击者不主动添加伪造标记的情况下EER超80%。这些数据表明,现有技术普遍难以对抗高质量语音伪造,提供有效保护,暴露出当前系统在应对深度伪造攻击方面存在的严重安全隐患。所以,我们能做什么来保护我们的语音呢?

首先,提高对个人语音的保护意识,不轻易发布个人语音内容(特别是清晰、单人说话音频);警惕“语音指令”式操作的金融/智能服务;遇到亲友“语音求助”,可通过文字或视频方式再确认。

其次,随着强制性国标《网络安全技术人工智能生成合成内容标识方法》的正式发布,国家从法规层面对包括合成语音在内的合成内容提出了明确的标识要求,为合成内容的反滥用奠定坚实基础。

此外,还应加大对深度伪造检测技术的研究投入,用“魔法”打败“魔法”,帮助公众更好地识别合成内容与真实内容的差异。

IEEE S&P 2025创办于1980年,是信息安全领域顶尖四大国际会议之一,长期保持12%–15%的录用率,其录用论文代表了全球网络与系统安全研究的最新进展与前沿方向,受到学术界与工业界的广泛关注。在2025年,S&P共收到1740篇投稿,最终录用257篇,录用率仅为14.8%。